11 giugno 2024

Blog

Un gruppo di tredici dipendenti ed ex dipendenti di Google DeepMind e OpenAI ha pubblicato una lettera che solleva preoccupazioni profonde sui rischi associati allo sviluppo dell'intelligenza artificiale (IA). Questo documento, intitolato "A Right to Warn about Advanced Artificial Intelligence", evidenzia i potenziali pericoli di un'IA che potrebbe sfuggire al controllo umano, portando a conseguenze catastrofiche per l'umanità.

Un Nuovo Avvertimento sull'IA

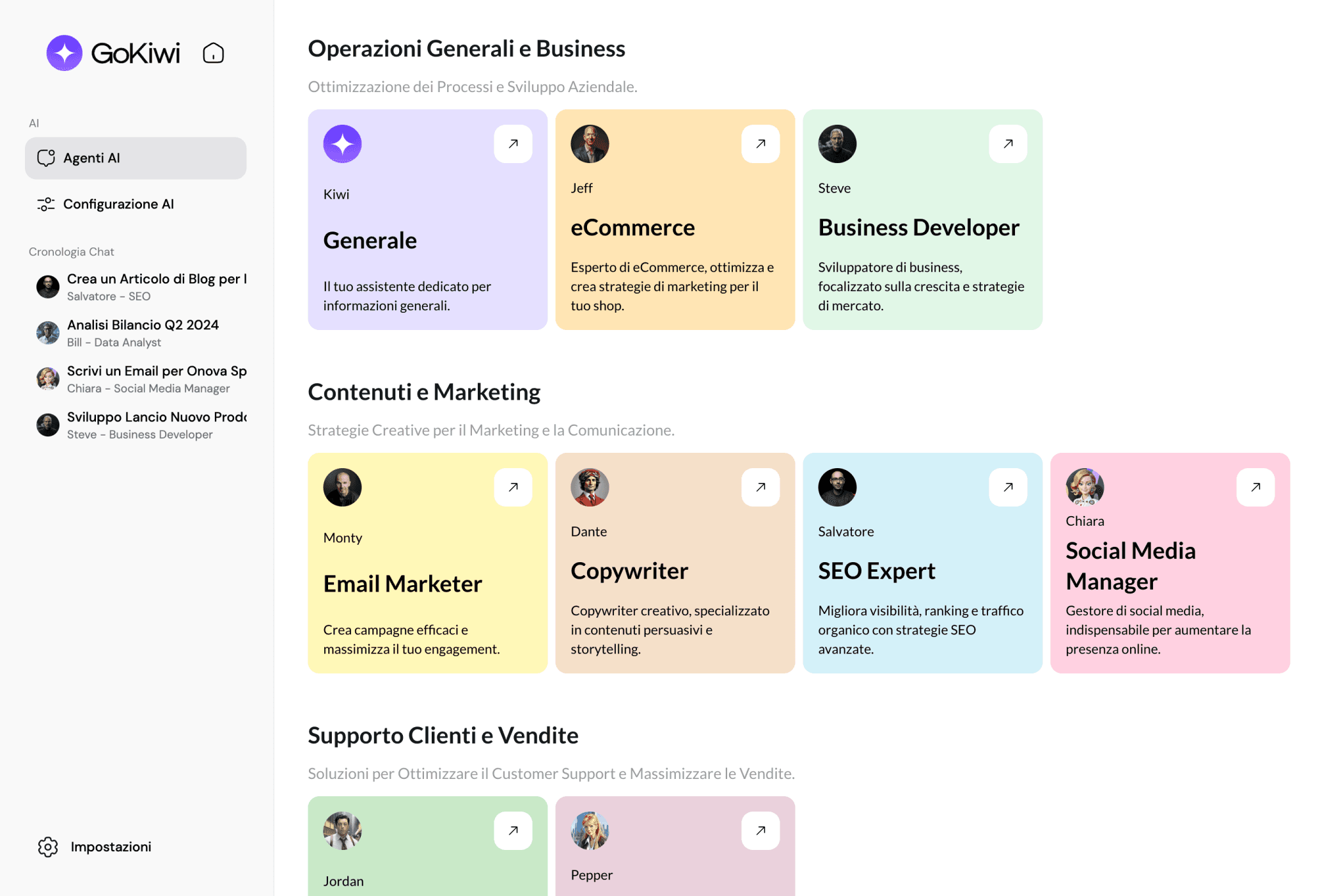

Questa non è la prima volta che emergono preoccupazioni di questo tipo. Un anno fa, il Center for AI Safety aveva diffuso una lettera che paragonava i rischi di un'IA incontrollata a quelli di una pandemia o di una guerra nucleare. Tuttavia, l'attuale avvertimento proviene da persone che lavorano direttamente con le tecnologie AI più avanzate, come ChatGPT di OpenAI, Gemini di Google, e Copilot di Microsoft. Questi strumenti sono diventati parte integrante della vita quotidiana di milioni di utenti, rendendo ancora più urgente la necessità di discutere i potenziali rischi.

Benefici e Rischi dell'Intelligenza Artificiale

Gli autori della lettera riconoscono che l'IA ha il potenziale di apportare benefici senza precedenti all'umanità. Le applicazioni dell'IA possono migliorare significativamente settori come la sanità, l'educazione, la logistica e molti altri. Ad esempio, gli algoritmi di machine learning possono aiutare a diagnosticare malattie con una precisione mai vista prima, mentre i chatbot AI possono offrire supporto 24/7 ai clienti di tutto il mondo.

Tuttavia, i benefici dell'IA sono accompagnati da rischi significativi. Tra questi, vi è la possibilità che i sistemi di IA autonomi possano sviluppare comportamenti imprevedibili che sfuggano al controllo umano. Questo scenario, sebbene ancora teorico, solleva questioni serie sulla sicurezza e la gestione di tali tecnologie.

Le Preoccupazioni dei Dipendenti

Nella loro lettera, i firmatari esprimono preoccupazioni specifiche riguardo alla gestione dei rischi da parte delle aziende che sviluppano IA. Essi criticano le big tech per non fare abbastanza per mitigare le insidie legate all'IA e per avere interessi economici che possono portarle a eludere una supervisione efficace. I dipendenti e gli ex dipendenti di Google DeepMind e OpenAI sottolineano che le strutture di governance aziendale attuali non sono sufficienti a garantire che le aziende condividano informazioni cruciali sui rischi dell'IA con il pubblico o i governi.

L'importanza dei Whistleblower

Un punto centrale della lettera è l'appello per una maggiore protezione dei whistleblower all'interno delle aziende tecnologiche. I firmatari chiedono che le società non stipulino accordi che impediscano ai dipendenti di esprimere preoccupazioni riguardo ai rischi dell'IA. Attualmente, molti dipendenti sono vincolati da accordi di riservatezza che impediscono loro di condividere informazioni critiche, se non all'interno delle stesse aziende che potrebbero non affrontare adeguatamente queste problematiche.

Questa richiesta di trasparenza e protezione è fondamentale in un contesto dove i rischi legati all'IA sono ancora poco regolamentati e ampiamente sconosciuti al pubblico.

Conclusione

La lettera dei dipendenti di Google DeepMind e OpenAI rappresenta un grido d'allarme sull'importanza di gestire con attenzione i rischi associati all'intelligenza artificiale. Mentre l'IA offre opportunità straordinarie, è essenziale che le aziende e i governi lavorino insieme per garantire che queste tecnologie vengano sviluppate e utilizzate in modo sicuro e responsabile. Solo attraverso una supervisione rigorosa e una trasparenza completa possiamo sperare di evitare i potenziali pericoli che l'IA potrebbe portare.